W ramach konkursu Narodowego Centrum Badań i Rozwoju INFOSTRATEG, realizowanego na zlecenie Ministerstwa Zdrowia, AGH oraz firma Proassist stworzą inteligentnego asystenta głosowego dla lekarzy i personelu medycznego. Konsorcjum otrzymało na ten cel grant w wysokości 9 mln zł.

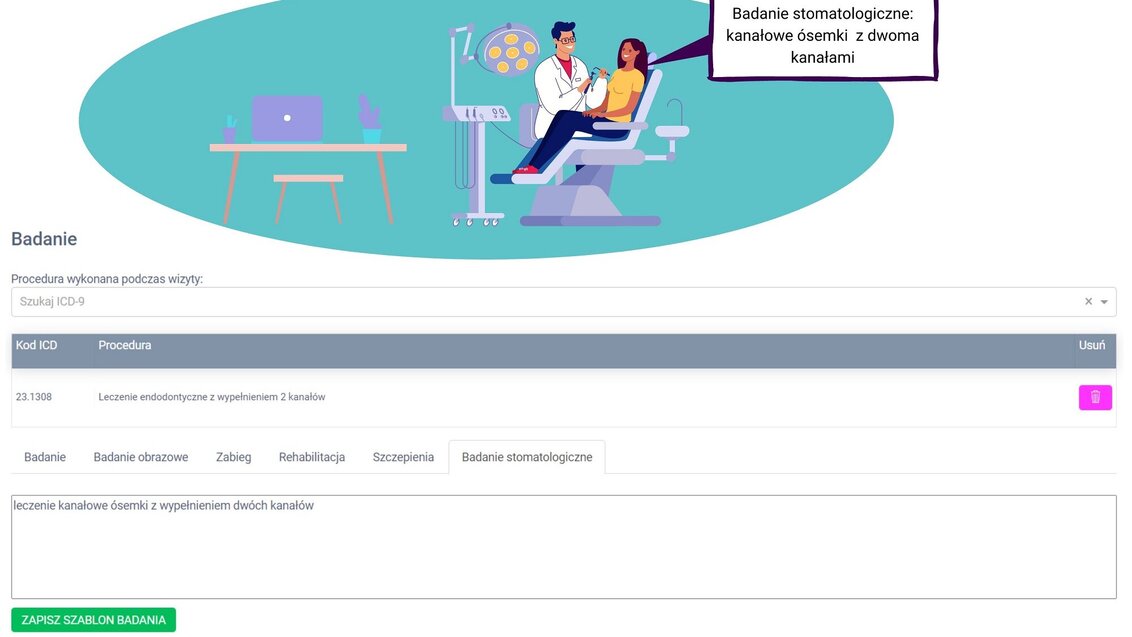

Projekt zakłada stworzenie asystenta głosowego rozpoznającego naturalną mowę użytkownika i wykonującego powierzone zadania, który będzie wsparciem dla lekarzy oraz personelu medycznego w codziennej pracy. Dzięki takiemu rozwiązaniu lekarz będzie mógł wydawać polecenia głosowe. Komendy wydawane przez medyków będą ułatwiały m.in. wystawienie e-skierowań, e-recept czy zwolnień lekarskich. Nadrzędnym celem projektu jest optymalizacja czasu pracy lekarzy oraz zmniejszenie pracy dokumentacyjnej medyków związanej z obsługą pacjentów. Takie rozwiązanie przełoży się na zwiększenie uwagi specjalisty w trakcie wizyty wyłącznie na pacjencie oraz skrócenie czasu trwania samej wizyty i konsultacji.

Projekt asystenta głosowego dla lekarzy, realizowany przez Proassist i zespół naukowców z AGH, zakłada w pierwszym etapie gromadzenie materiału głosowego. W tym celu lekarze będą nagrywali swój głos podczas wizyt i konsultacji z pacjentami. Zebrane dane posłużą do zbudowania bazy danych i doskonalenia asystenta głosowego. Realne dane z wizyt lekarskich są kluczowym elementem projektu, umożliwiającym dostosowanie asystenta głosowego do konkretnych potrzeb i preferencji lekarzy. Wiedza i doświadczenie zgromadzone przez lata pracy zawodowej medyków będą stanowić cenny wkład w rozwój rozwiązania.

Za realizację projektu ze strony AGH odpowiada dr hab. inż. Konrad Kowalczyk, prof. AGH z Instytutu Elektroniki na Wydziale Informatyki, Elektroniki i Telekomunikacji pełniący w projekcie funkcję kierownika B+R, który wyjaśnia:

– Naszym celem jest ułatwienie i usprawnienie pracy lekarza poprzez konwersję wypowiedzi lekarza na tekst, a następnie automatyczne wyodrębnienie pożądanych informacji i odpowiednie uzupełnienie formularzy elektronicznej dokumentacji medycznej. Pracujemy nad opracowaniem asystenta głosowego dostosowanego do zastosowań medycznych, który będzie składał się z modułów sztucznej inteligencji odpowiedzialnych za automatyczne rozpoznawanie mowy i przetwarzanie języka naturalnego.

Zespół prof. Konrada Kowalczyka składa się z około 10 osób: adiunktów, asystentów, doktorantów i studentów związanych z Zespołem Przetwarzania Sygnałów Wydziału Informatyki, Elektroniki i Telekomunikacji, który od wielu lat specjalizuje się w przetwarzaniu i analizie mowy. W początkowej fazie projektu zespół będzie odpowiadał m.in. za przygotowanie systemu umożliwiającego zamianę mowy na tekst wraz z analizą semantyczną wypowiedzi, a w dalszych etapach projektu za stworzenie generycznego systemu głosowego zawierającego moduły automatycznego rozpoznawania mowy i przetwarzania języka naturalnego obsługujące zdefiniowane scenariusze użycia. Liderami prowadzonych prac badawczo-rozwojowych będą doświadczeni adiunkci Wydziału Informatyki, Elektroniki i Telekomunikacji: dr inż. Stanisław Kacprzak i dr inż. Marcin Witkowski.

fot. archiwum AGH

Zbiórka gadżetów na kiermasz charytatywny

Zbiórka gadżetów na kiermasz charytatywny  Wejdź do świata odległej przyszłości. Larp „Pierwiastek Rosena”

Wejdź do świata odległej przyszłości. Larp „Pierwiastek Rosena”  Prezentacja wyborcza kandydata na rektora AGH prof. Jerzego Lisa

Prezentacja wyborcza kandydata na rektora AGH prof. Jerzego Lisa  Zespół Bioceramiczny AGH ze złotym medalem w Genewie

Zespół Bioceramiczny AGH ze złotym medalem w Genewie  Profesor Jerzy Lis ponownie Rektorem AGH

Profesor Jerzy Lis ponownie Rektorem AGH